Desarrollar proyectos de inteligencia artificial ya no es asunto exclusivo de las grandes empresas de tecnología. Desde hace algunos años, la inversión en este tipo de proyectos, por parte de entidades públicas y privadas de todos los tamaños, ha tenido un crecimiento exponencial. De hecho, la Unión Europea ha considerado que el impacto económico mundial de la inteligencia artificial (“IA”) para el año 2030 se estima en 14 billones de euros[1].

Con el crecimiento del número de proyectos que involucran IA se han empezado a resaltar los riesgos asociados a su desarrollo, y la vulneración a la privacidad es uno de los que encabeza la lista. ¿Cuál es la justificación de esto?

La IA hace referencia a sistemas de computación que son capaces de aprender desde sus propias experiencias y así responder a problemas complejos en diferentes situaciones[2]. Para lograr estos “procesos de aprendizaje” es necesario someter a los sistemas a diferentes experiencias a partir del procesamiento de gran cantidad de información que es, en la mayoría de los casos, información de carácter personal. Dicho procesamiento inicia desde el momento mismo del diseño y programación del sistema e incluso puede extenderse por años cuando su utilidad y eficiencia así lo requieran.

Ahora bien, en muchos escenarios, los problemas complejos que se pretenden resolver se basan, no solo en información personal estándar, sino en aquella que pertenece a la esfera más íntima de las personas, lo cual, naturalmente, genera riesgos en la vulneración de derechos como la privacidad, la protección de datos y otros asociados. De ahí que existan puntos de conexión entre la IA y la privacidad, que hacen que merezca ser regulada.

En la esfera internacional…

Se ha avanzado en este sentido. El Acuerdo Sobre Inteligencia Artificial de la Organización para la Cooperación y el Desarrollo Económicos – OCDE y el Libro Blanco sobre Inteligencia Artificial, una aproximación a la excelencia y a la confianza de la Unión Europea, son algunos ejemplos de ello. Asimismo, algunos países han desarrollado guías, proyectos de regulaciones e incluso creado organismos, todo tendiente a proveer algunas herramientas de cómo aproximarse a la mencionada convergencia[3].

Vale la pena destacar que los avances mencionados de ninguna manera presentan una regulación detallada de la materia. Como se señaló, son lineamientos generales de los aspectos claves a considerar. En todo caso, en el desarrollo de proyectos de IA será fundamental siempre tener en cuenta la normativa aplicable en cada jurisdicción en materia de privacidad y protección de datos personales, que con seguridad contendrá disposiciones más claras y concretas sobre cómo debe procesarse información personal.

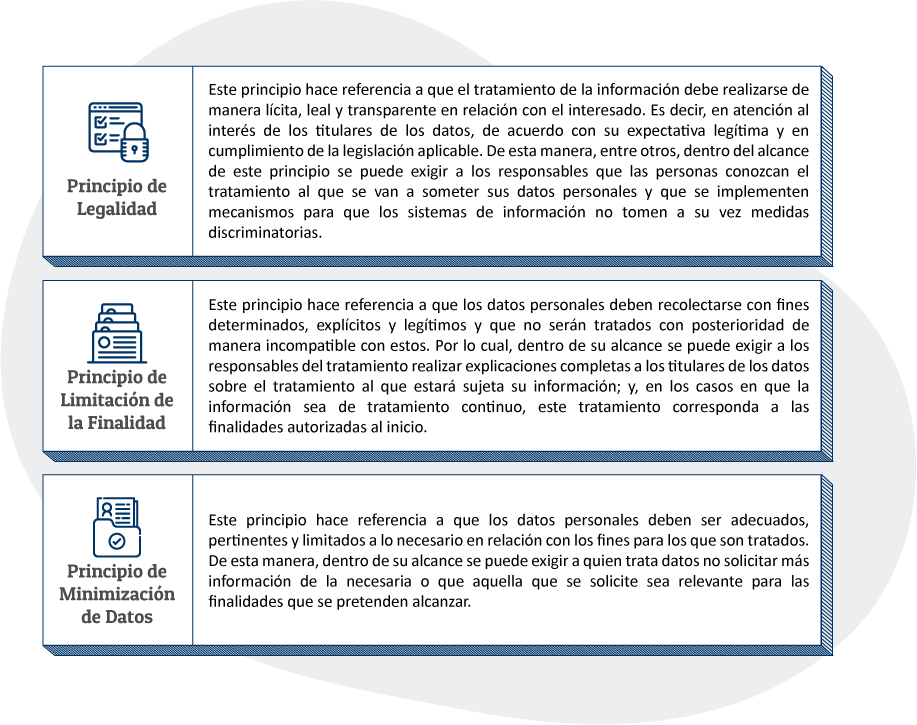

A manera de ejemplo, la Regulación General de Datos Personales de la Unión Europea cuenta con lineamientos plasmados a manera de principios rectores que, sin decirlo concretamente, son aplicables al procesamiento de información en sistemas de IA, algunos de ellos a continuación:

En Colombia…

La normativa sobre protección de datos personales no ha hecho referencia de manera expresa al tratamiento de información en proyectos de inteligencia artificial. Sin embargo, el Gobierno Nacional ya abrió el debate con la presentación del Marco Ético para la Inteligencia Artificial, que se sometió a discusión por medio de la construcción de mesas de trabajo que permitieron el análisis de las oportunidades y desafíos de la IA, con la participación de expertos en diferentes áreas, desde el 24 de noviembre al 2 de diciembre de 2020. Asimismo, la Superintendencia de Industria y Comercio (“SIC”), como máxima autoridad en materia de protección de datos personales, se está preparando para desarrollar el primer sandbox sobre IA y Privacidad.

Mientras seguimos avanzando en regulaciones que consideren la relación entre IA y privacidad a nivel global y local, a continuación presentamos un TOP 10 de recomendaciones que se sugieren tener en cuenta para el Tratamiento de Datos en Proyectos de Inteligencia Artificial de la Red Iberoamericana de Protección de Datos, las cuales, si bien no son vinculantes, se encuentran sincronizadas con los principios que generalmente se consideran en todas las regulaciones recientes de protección de datos personales:

- Cumplir las normas que le sean aplicables sobre el tratamiento de datos personales al proyecto, sin olvidar el posible impacto de normas extranjeras cuando el proyecto involucre tratamiento transfronterizo de datos.

- Incorporar la privacidad desde el diseño (Privacy by Design) de tal manera que se consideren aspectos claves de la privacidad desde la concepción del proyecto.

- Efectuar estudios de impacto en privacidad en cada proyecto que implique procesamiento masivo de datos, con una clara identificación de los aspectos a tener en cuenta en cada fase del ciclo de vida de los datos.

- Implementar medidas técnicas para asegurar la seguridad y calidad de los datos.

- Utilizar técnicas de minimización de riesgo por el procesamiento masivo de datos, como la spseudonimización y anonimización.

- Adoptar medidas para garantizar el respeto a los principios sobre tratamiento de datos personales en los proyectos de IA, dentro de los cuales se destacan, para efectos de proyectos de IT, el de proporcionalidad, de acceso y circulación restringida y de transparencia.

- Reconocer los intereses, expectativas, necesidades y deseos de los titulares de los datos e implementar estrategias para considerarlos.

- Garantizar los derechos de los titulares de los datos personales e implementar mecanismos efectivos para su ejercicio.

- Desarrollar esquemas apropiados de gobernanza sobre tratamiento de datos personales en las organizaciones que desarrollan productos de IA.

- Ser transparente en el procesamiento de la información de tal manera que se incremente la confianza y la transparencia con los titulares de los datos personales.

Notas de pie

[1] Gobierno Español. Ministerio de Ciencia, Innovación y Universidades. Estrategia española de I+D+I en inteligencia artificial. 2019.

[2] The Norwegian Data Protection Authority. Artificial intelligence and privacy. Report. 2018.

[3] Algunos ejemplos de esto son la Guía en la seguridad de herramientas inteligentes y la Estrategia en Economía Digital del 2015-2018 desarrollados en el Reino Unido, la Orden ETD/670/2020 por la que se crea y regula el Consejo Asesor de Inteligencia Artificial en España, y el Proyecto de Ley S. 1558, de orden federal, de inteligencia artificial de Estados Unidos.

Por: